Makineler gün geçtikçe daha akıllı hale geliyor. Onlar kendi kendilerine öğrendikleri ve kendi kararlarını verdikleri konuma gelmişlerdir. Sonuçlar açıkça garip olabilir. Hayal eden insanların beynindeki kelimeleri okuyan ve kendilerini sanat ustalarına dönüştüren makineler mevcut.

Daha karanlık yetenekler herhangi birine, geliştirilmekte olan anti yapay zekâ cihazını giydirmek için yeterli donanıma sahiptir.

Bazı yapay zekâ sistemleri, akıl hastalığı ve önyargı belirtileri gösterirken, diğerleri halka açıklanamayacak kadar tehlikelidir.

İlginizi çekebilir: Yapay Zeka (AI) Nedir?

10 – Sahte Derinlik

2019 yılında, YouTube’da bir video yayınlandı. Ünlü Mona Lisa’nın farklı kliplerini gösteriyordu. Fakat bu sefer resimler rahatsız edici şekilde canlıydı. Kadının kafasını hareket ettirdiğini, etrafına baktığını ve dudaklarının sessizce konuştuğunu gösteriyordu.

Mona Lisa, bir tuvalden çok röportaj yapan bir film yıldızına benziyordu. Bu en klasik örneğidir. Bu canlı portreler, evrişimsel sinir ağları tarafından oluşturulur. (Evrişimsel sinir ağları, derin öğrenmenin bir alt dalıdır ve genellikle görsel bilginin analiz edilmesinde kullanılır. Yaygın kullanım alanları resim ve video tanıma, öneri sistemleri resim sınıflandırma, tıbbi görüntü analizi ve doğal dil işleme olarak sıralanabilir.)

Bu tür bir yapay zeka, görsel bilgiyi bir insan beynine benzer şekilde işler. Yapay zekâya insan yüzünün karmaşıklıklarını öğretmek, hareketsiz bir görüntüyü gerçekçi bir videoya dönüştürebilmek için zor bir çalışma gerektirdi.

Sistemin önce yüz özelliklerinin nasıl davrandığını öğrenmesi gerekiyordu ki bu kolay bir başarı değildi. Bir bilim adamının açıkladığı gibi, 3 boyutlu bir kafa modeli “on milyonlarca parametreye” sahiptir. [1]

Yapay zekâ ayrıca klipleri oluşturmak için üç canlı modelden bilgi topladı. Bu nedenle kadın Mona Lisa olarak tanınır, ancak her biri modellerin kişiliklerinin izlerini taşır.

9 – Yapay Zekâ Önyargısı

Ön yargı ile savaşmak zordur. Bedenleri ve inançlarından dolayı ayrımcılığa uğramış herkese sorabiliriz. Bu derdin başka bir katmanı yakın zamanda yapay zekâdan dolayı ortaya çıktı.

Birkaç yıl önce, Twitter trollerinin Microsoft’un yeni sohbet robotu Tay’ı bir neo-Nazi’ye dönüştürmek için 24 saatten daha az bir süreye ihtiyacı vardı. Bununla birlikte araştırmalar, yapay zekânın kadın ve yaşlıları küçümsemesindeki tek nedenin troller olmadığını keşfetti. Sinir ağları, internet sitelerinden bilgi işlerken insan dilinden önyargıları öğrenir.

Bilim insanları son zamanlarda Glove (Kelime Betimlemesi için Global Vektörler ) için bir sözcük çağrışımı testi geliştirdiler. Bu yapay zekâ geniş çapta sözcük betimlemesi görevlerinde kullanılıyor. Deneyin sonunda araştırmacılar dahi şaşkına döndü.

Glove’da test edebilecekleri her önyargıyı bulmuşlardı. Diğerlerinin yanı sıra, Afrikalı-Amerikalı ve yaşlıların isimleriyle daha olumsuz şeyler ilişkilendirdi ve kadınları kariyerden çok aile terimiyle bağladı.

Gerçek şu ki, toplum genellikle belirli gruplara daha fazla acı veriyor ve yapay zekâ sistemleri bunu fark ediyor. Aradaki fark insanların adaleti anlaması ve birine karşı ayrım yapmamayı seçebilmesidir, bilgisayarlar bunu yapamaz.

8 – İnsan Gibi Uyur

Uyku kavramayı geliştirir ve vücudu yeniler. Şekerlemenin, nöronlara gün içinde yapılan gereksiz anıları atmasına izin verdiğine dair kanıtlarda var.

2019’da bilim insanları, Hopfield ağı adlı bir YSA (yapay sinir ağı) içinde uyuma yeteneğini programladılar. Uyuyan memeli hayvan beyninden esinlenen YSA, çevrimiçiyken “uyanıktı” ve çevrimdışıyken uyuyordu.

Çevrimdışı olmak yapay zekânın kapatıldığı anlamına gelmiyordu. Matematiksel olarak uygulanan insan uyku modelleri, ona REM(Hızlı Göz Hareketi ) ve yavaş dalga uykusuna benzer bir şey verdi. REM’in önemli anıları sakladığına inanılırken, yavaş dalga fazı gereksiz olanları azaltıyordu.

İnanılmaz bir şekilde YSA da rüya görüyordu. Çevrimdışıyken, o gün öğrendiği her şeyi gözden geçirdi ve daha büyük hafıza kapasitesiyle uyandı.

Şekerlemeye izin verilmediğinde, YSA uykusuz bir insan gibi oluyordu – öğrenme yeteneği büyük ölçüde azaldı. Bu keşif bir gün tüm yapay zekâ sistemleri için uykuyu zorunlu hale getirebilir.[3]

7 – Yapay Zekâ Karşıtı Yapay Zekâ (Anti AI)

Teknoloji hızla gelişiyor ve en kasvetli tahmin, varoluşumuzun sahte yapay zekâ tarafından tehdit edilmesiyle ilgili. Herhangi bir yapay zekâ değil, aynı zamanda olağanüstü güçlü ve kendi kendine gelişen sistemler.

2017’de, Avustralya ‘lı araştırmacıların yapay zekâ karşıtı bir cihaz geliştirmesi sadece beş gün sürdü. İnsanların çoktan karşılaştığı bir sorunu çözmek için tasarlanmıştı – Yapay zekâ gerçek bir insan gibi davranıyordu. Giyilebilir prototip, yapay bir sahtekarla karşılaştığında sahibini uyarmak için tasarlandı.

Sentetik sesler üzerinde çalıştı ve makine öğrenim yazılımı olan Google’ın Tensorflow’undan yararlandı. Prototip kullanımdayken, varlığındaki tüm sesleri yakalar ve Tensorflow’a gönderir.

Bir insan tespit edildiğinde cihaz hiçbir şey yapmaz. Ancak, eğer hoparlör yapay ise sistem insanı çok korkutur. Yaratıcıları, “bir klon uyarısıyla konuştuğunuzun” hemen fark edilmemesine karar verdi. Bir zil veya vızıltı yerine, termoelektrik bir element boynun arkasını soğutur.

6- AI-DA

Ai-Da adlı robot, sanat sahnesinin sevgilisidir ve belki de her yerde mücadele eden sanatçılar için baş belasıdır. Karmaşık resimleri, heykelleri ve eskizleri bolca üretir. Bu kadar dikkat çekici olan şey, makinenin kendi kendine yaratıcı olmak için gittikçe karmaşıklaşan yollar öğretmesidir.

Oxford’da bulunan Ai-Da’nın bitkin, ışıksız hücresindeki çalışmaları özellikle takdire değerdir. Aslında günümüzün en iyi soyut ressamlarının yarattığı tablolarla aynıdırlar.

Makinenin başka becerileri de var. Konuşur, yürür ve fırça, kalem tutar. Aynı zamanda bir sanat sergisi düzenleyen ilk yapay zekâdır. Parçalar, siyaset ve övgü içeren konularla ünlü insanlara “unutulmaz derecede güzel” olarak tanımlandı.

Ai-Da, 2017’de “doğdu”. Yapay zeka, bir sanat müdürü olan Aidan Meller tarafından görevlendirildi. Robotu yapmak için bir Cornwall robotik firması ve Leeds’teki mühendislerle görüştü. İkincisi, yapay zekânın kullandığı eli göz alıcı bir parlaklıkta tasarladı. Şaşırtıcı bir şekilde, makineye en yakın olanlar bile makinenin gerçek üretim kapasitesini veya bundan sonra ne yapacağını tahmin edemez.

5- Ses Kliplerinden Yüz Tahmini

Gelecekte isimsiz bir telefon görüşmesi yapmak imkânsız hale gelebilir. Birinin kısa bir ses kaydını dinleyen ve ardından kişinin neye benzediğini tahmin eden bir yapay zekâ sistemi var.

Yapay zekâ Massachusetts Teknoloji Enstitüsü’nde (MIT) eğitim aldı ve seslerden başka hiçbir şeye bağlı olmayan yüzleri nasıl çizeceğini öğrenmek için çevrimiçi videoları izledi. Yeniden yapılanma sonuçları pürüzlüydü ama kesinlikle yaşayan bireylere benzerlik gösterdi. Hatta o kadar benzerlerdi ki MIT ekibini rahatsız etti.

Birçok teknolojide olduğu gibi, sesle yüz yüze yapay zekânın kötüye kullanım aracı haline gelme riski vardı. Örneğin, telefon görüşmesi yapan bir kişi görünüşüne göre ayrımcılığa uğrayabilir. Bununla birlikte diğer taraftan, bu yapay zekâ kolluk kuvvetlerinin fidye çağrılarıyla tehdit edici aramalar yapan veya adam kaçıranların resimlerini derlemesine yardımcı olabilir.

MIT, yapay zekâ sisteminin eğitimine ve gelecekteki uygulamasına yönelik etik bir yaklaşım sürdürmeyi planlıyor. [6]

İlginizi çekebilir: Akıllı Telefonların Yerini Ne Alacak?

4- Norman

MIT’in Media Laboratuvarında diğerlerinden farklı bir sinir ağı vardır. Norman denen yapay zekâ sistemi rahatsız edici. Bir kez olsun kamu sektöründe neleri açığa çıkarabileceği konuşulmadı. Bunun yerine, Norman’ın “zihni” karanlık düşüncelerle doldu. Ve bunlar düpedüz dehşet verici ve saldırgandır.

Araştırmacılar, yapay zekâyı mürekkep lekesi testleriyle sunduklarında bu tuhaflıkla karşılaştı. Psikologlar, bir hastanın altında yatan zihniyet hakkında daha fazla bilgi edinmek için bunları kullanır. Bir mürekkep lekesi diğer yapay zekâ ağlarına gösterildiğinde, sırasıyla bir kuş ve bir uçak gördüler. Norman bir arabadan vurulan ve kenara atılan bir adam gördü. Norman’ın hamur makinesine çekilen bir adam olarak tanımladığı başka bir mürekkep lekesine kıyasla uysaldı.

Anormal davranış, akıl hastalığına benzetildi. Bilim adamları, onu “psikotik” olarak adlandıracak cesareti buldular. Ancak bu yapay zekâyı yoldan çıkaran şey, onun yoluna devam etmesine yardımcı olabilir. Sinir ağları ne kadar çok bilgi alırsa, bağımsız seçimlerini o kadar çok iyileştirirler. MIT, Norman’ın insan tepkilerinden öğrenerek kendini düzelteceğini umarak halka bir mürekkep lekesi anketi açtı. [7]

İlginizi çekebilir: Psikoloji Hangi Amaca Hizmet Eder ve Neyi Amaçlar?

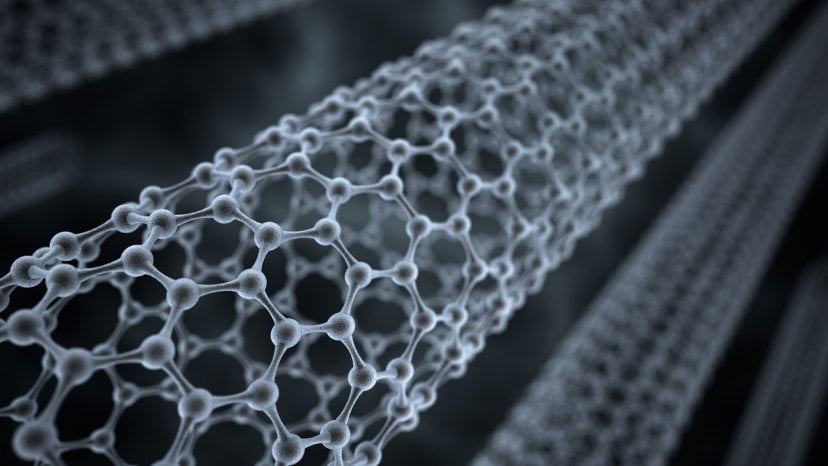

3- Yapay Zekâ Beyinde ki Kelimeleri Okur

2018’de üç farklı çalışma, yapay zekâya beyin dalgalarını kelimelere dönüştürmeyi başardı. Bunu yapmak için elektrotların doğrudan beyne bağlanması gerekiyordu. Etik nedenlerden dolayı bu sağlıklı hastalarla yapılamaz.

Bilim adamları, beyinleri alakasız cerrahi müdahalelere çoktan maruz kalmış gönüllülerden izin aldı. Bazıları ses dosyalarını dinlerken ve diğerleri yüksek sesle okurken, bilgisayar beyin dalgalarını kaydetti.

İlk çalışma, yapay zekânın verileri “derin öğrenme“ ile düzenlemesine izin verdi. Bu, insan gözetiminde çok az olan veya hiç olmayan bir sorunu çözen bilgisayarı tanımlar. Elektriksel beyin sinyallerini bir ses sentezleyicisi aracılığıyla dönüştürdükten sonra, kelimeler zamanın yaklaşık yüzde 75’ini tanınabilir hale getirdi.

İkinci çalışma, yapay zekâyı öğretmek için nöronları ve konuşma seslerini ateşleyerek yapılan modellerin bir karışımını kullandı. Ortaya çıkan ses dosyaları, bir mikrofon kaydının netliğine sahipti.

Üçüncü çalışma, konuşmayı kas hareketlerine dönüştüren, beyin bölgesini analiz eden başka bir yaklaşım kullandı. Dinleyiciler, yapay zekânın sözlerini yüzde 83 oranında anlamayı başardı.

2- Yapay Zeka Halk İçin Çok Tehlikeli

Adı “dull” (Kelime anlamı: sıkıcı). Bununla birlikte, GPT-2’nin o kadar tehlikeli olduğu söyleniyor ki, geliştiricileri tam sürümü halka yayınlamayı reddetti. GPT-2, bir dil tahmin sistemidir. Adı kadar sıkıcı gelebilir ama yanlış ellerde bu yapay zekâ yıkıcı olabilir.

GPT-2, yazılı bir örneğe dayalı olarak orijinal metin oluşturmak için tasarlanmıştır. Her zaman mükemmel olmasa da yapay zekânın sentetik malzemesi çoğu zaman fazla otantikti. İnandırıcı haberler üretebilir, İç Savaş hakkında makaleler yazabilir ve JRR Tolkien ‘in Yüzüklerin Efendisi’nden karakterlerle kendi hikâyesini yaratabilir. İhtiyaç duyduğu tek şey bir insan müdahalesiydi ve yapay özsuyu akacaktı.

[J.R.R. Tolkien hakkında daha fazla bilgi için buraya tıklayın.]

Bu gelişmiş yapay zekâyı ortaya çıkaran kar amacı gütmeyen grup OpenAI, 2019’da yalnızca sınırlı bir sürümün satışa çıkacağını söyledi. Topluluk, sistemin yalan haber salgınını daha da kötüleştirebileceğinden, insanları sosyal medyada sömüreceğinden ve gerçek kişileri taklit edebileceğinden korkuyordu.

1- Yapay Zekâ Kendini Öz Farkındalığa Döndürüyor

Yapay ağlar gelişmiş yetenekler sergiler ancak öz farkındalık yapay zekânın ısrarla başarısız olduğu önemli bir insan özelliğidir. 2015’te bu sınır bulanıklaştı. Bir New York robotik laboratuvarı, kullanıma hazır üç Nao robotunu test etti.

Minik insansılara, bir hapın onlardan ikisini susturduğu söylendi. Hiçbirine herhangi bir ilaç verilmedi. Ancak ikisi, insan tarafından basılan bir düğmeyle susturuldu. Robotlar, hangisinin hala konuşabildiğini bulmalıydı bu da başarısız oldukları bir görevdi. Bu başarısızlık tüm Nao modelleri “Bilmiyorum” demeye çalıştığı için gerçekleşecek şekilde tasarlandı.

Ancak o zaman bir robot onun hala konuşabildiğini keşfetti. Robot, “Üzgünüm, şimdi biliyorum! Bana aptal bir hap verilmediğini kanıtlayabildim.” diye haykırdı. Göründüğü kadar basit olmayan testi geçti. Nao, insanın “Hangi hapı aldın?” sorusunu anlamalıydı. Kendi kendine “Bilmiyorum” dediğini duyduğunda, yanıtın kendisinden geldiğini ve herhangi bir hap almadığının farkına vardığını anlamalıydı. Bu, yapay zekânın öz farkındalığı test etmek için tasarlanmış sözde bilge adam bulmacasında ilk kez başarılı oldu.

Serra Nur Salim

Yorumlar 9